AI - seus riscos e efeitos colaterais

O Conselho de Ética aconselha o governo alemão e avisa contra o entusiasmo acrítico pelo uso da inteligência artificial.

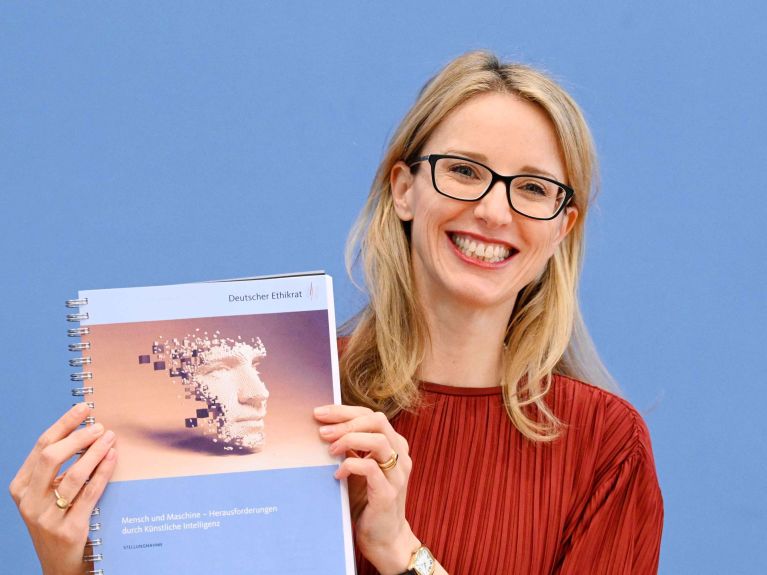

A inteligência artificial é onipresente. "Pode ser usado para diagnosticar câncer ou para aprender vocabulário em inglês com os alunos, mas também para determinar quem deve receber certos benefícios sociais e influenciar nosso comportamento nas mídias sociais", diz a professora Alena Buyx, presidente do Conselho de Ética alemão. Simplificar processos e aliviar as pessoas do fardo de reconhecer doenças soa como um admirável mundo novo. Entretanto, o Conselho de Ética, encarregado pelo Parlamento Federal em 2020 para examinar as oportunidades e os perigos da IA, não vê o futuro como todo rosado. "A IA não deve substituir os humanos", diz a presidente do grêmio de cientistas de várias disciplinas, que aconselha os políticos e o governo sobre questões éticas. Buyx formula assim o resultado central: "O uso de IA deve expandir o desenvolvimento humano, a autoria e a possibilidades de ação, não diminuí-los".

A IA não deve substituir os humanos.

Em sua declaração de 287 páginas "Homem e Máquina", o Conselho de Ética escreveu sobre os perigos e chances que o grêmio associa às novas tecnologias. O relatório (em alemão) foi apresentado em Berlim em meados de março. Uma importante tarefa do Conselho de Ética é olhar de forma crítica os novos desenvolvimentos e avisar sobre os perigos. É o que faz em seu parecer. Judith Simon, professora de Ética em Tecnologia da Informação na Universidade de Hamburgo, diz que o objetivo de transferir tarefas para a IA deve, em princípio, servir para expandir as capacidades humanas. A tarefa é, portanto, "evitar uma diminuição da ação humana e da autoria, assim como uma difusão da responsabilidade."

A responsabilidade não pode ser delegada às máquinas.

O professor, Julian Nida-Rümelin, ex-ministro de Estado da Cultura da Alemanha, também destaca a importância da responsabilidade humana. Ela não pode ser "delegada às máquinas ou compartilhada com máquinas". O Conselho de Ética vê grandes perigos à espreita especialmente no uso da inteligência artificial na mídia e na comunicação, como em motores de busca, ofertas de notícias ou mídia social, se não houver um uso transparente da IA. As ofertas personalizadas em particular poderiam dar a impressão de uma seleção objetiva, mas na verdade refletem o comportamento anterior do usuário processado pela IA. A razão é o interesse comercial dos provedores privados em vincular seus usuários. "O resultado é um estreitamento do espectro de informações e opiniões sobre a oferta", avisa Nida-Rümelin. De acordo com o Conselho de Ética, uma maneira de contrariar isso poderia ser uma estrutura pública de comunicação digital, como uma alternativa às plataformas das corporações digitais privadas. Isso não deve ser confundido com a radiodifusão pública na Alemanha. Essas plataformas poderiam ser operadas por fundações públicas, por exemplo, sem muita influência estatal, disse Nida-Rümelin.

Você quer receber regularmente informações sobre a Alemanha? Clique aqui para se registrar: